Tecnología

El impacto medioambiental de la IA generativa en cinco cifras

Estas cinco cifras son una muestra de ese impacto:

Consume diez veces más que Google

Cada búsqueda en ChatGPT, el robot de conversación de OpenAI capaz de generar todo tipo de contenidos con una simple petición, consume 2,9 Wh de electricidad.

Esto representa un gasto diez veces superior al de una búsqueda en Google, según la Agencia Internacional de la Energía (AIE).

Actualmente, OpenAI reivindica 300 millones de usuarios semanales, con alrededor de 1.000 millones de peticiones enviadas diariamente.

Más allá de ChatGPT, que popularizó la IA generativa con su lanzamiento en 2022, existe un amplio abanico de robots conversacionales.

Solo en Francia, por ejemplo, casi el 70% de los jóvenes de entre 18 y 24 años declaran usar esta tecnología, según una encuesta del instituto de sondeos Ifop.

3% del consumo eléctrico en 2030

Los centros de datos, que almacenan la información y aportan las enormes capacidades de cálculo requeridas por la IA, son la base de esta tecnología.

En 2023, estas infraestructuras digitales representaron casi el 1,4% del consumo eléctrico mundial, según un estudio de Deloitte.

Ante el vertiginoso crecimiento de su uso, la cifra podría alcanzar el 3% del gasto global en 2030, unos 1.000 TWh, el consumo anual combinado de Francia y Alemania, afirma esta consultoría.

De su lado, la AIE prevé un aumento de más del 75% en la demanda de electricidad de estos centros entre 2022 y 2026, impulsado por la IA y las criptomonedas.

A este ritmo, un 40% de los centros de datos dedicados a la inteligencia artificial no recibirán suficiente suministro eléctrico en 2027, según un estudio de la firma estadounidense Gartner.

300 toneladas de CO2

Entrenar un gran modelo de lenguaje de IA genera cerca de 300 toneladas de CO2, el equivalente a 125 vuelos de ida y vuelta entre Nueva York y Pekín, estimaron investigadores de la universidad estadounidense Massachusetts Amherst en 2019.

Expertos de Oxford llegaron a una conclusión similar en 2021, calculando que una sola sesión de entrenamiento de GPT-3, el modelo de OpenAI que sostiene a ChatGPT, producía 224 toneladas de CO2.

Y para conseguir avances, las empresas deben entrenar a miles de modelos.

Sin embargo, resulta complicado evaluar con precisión las emisiones de gases de efecto invernadero provocadas por la IA generativa.

Expertos e instituciones internacionales denuncian que la información sobre las condiciones de fabricación de estos modelos y sobre los centros de datos es escasa, y que faltan reglas mundiales de medición.

6.600 millones de metros cúbicos de agua en 2027

El funcionamiento de los centros de datos precisa de sistemas de refrigeración que consumen una gran cantidad de agua.

Por ejemplo, GPT-3 consume casi medio litro de agua para generar entre 10 y 50 respuestas, según una estimación prudente de investigadores de la Universidad de California Riverside y la Universidad de Texas Arlington.

Su estudio publicado en 2023 calculaba que el crecimiento de la demanda de IA requerirá el consumo de entre 4.200 y 6.600 millones de metros cúbicos de agua en 2027, lo que representa entre cuatro y seis veces el consumo anual de Dinamarca.

2.600 toneladas de residuos electrónicos

Esta tecnología también generó 2.600 toneladas de residuos electrónicos en 2023, como tarjetas gráficas, servidores o tarjetas de memoria, según un estudio publicado en la revista científica Nature Computational Science.

La cifra podría crecer hasta los 2,5 millones de toneladas en 2030, una cantidad equivalente a 13.300 millones de celulares inteligentes, según este estudio.

Además, los servidores informáticos y los chips necesarios para desarrollar la IA implican el uso de metales raros, cuya extracción intensiva, especialmente en África, se lleva a cabo mediante procedimientos contaminantes, apunta la Agencia de la Transición Ecológica de Francia.

Principal

VIDEO | China presenta una ‘selección’ de futbolistas robots

La portavoz del Ministerio de Relaciones Exteriores de China, Mao Ning, compartió en redes sociales en el que aparece un robot humanoide de fabricación china realizando múltiples toques a un balón de fútbol.

Junto a las imágenes, la funcionaria hizo referencia a la próxima Copa Mundial de la FIFA 2026 y destacó el avance tecnológico del país en el desarrollo de robots.

«¡Cuenta regresiva para la Copa Mundial de la FIFA 2026! Mientras que la selección china de futbolistas sigue entrenando para 2034, la selección china de robots ya está lista», escribió Mao Ning al acompañar la publicación.

El video muestra al robot manteniendo el control del balón mediante repetidos golpes, una demostración que rápidamente llamó la atención de usuarios en plataformas digitales.

Countdown to the 2026 FIFA World Cup! 🇨🇦🇺🇸🇲🇽

While Chinese human team is still training for 2034, Chinese robot team is ready. pic.twitter.com/Uh3jYi1xd7

— Mao Ning 毛宁 (@SpoxCHN_MaoNing) June 6, 2026

Principal

Un chip con neuronas humanas aprende a jugar a «Doom»

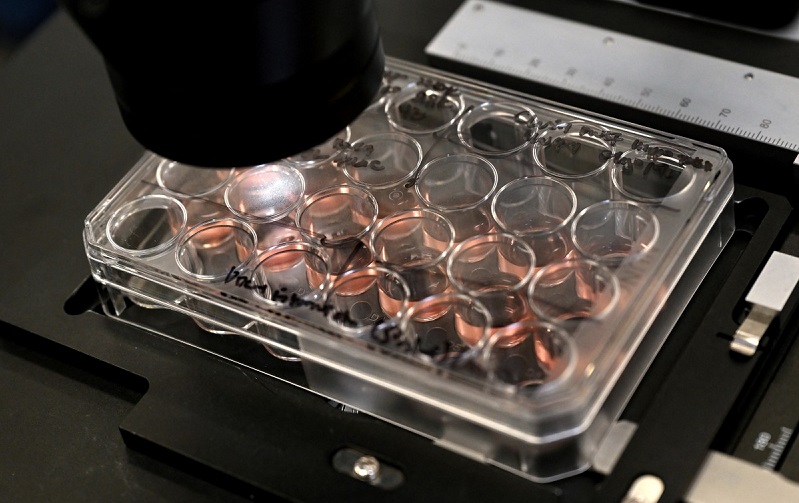

Investigadores australianos lograron que neuronas humanas cultivadas en laboratorio e integradas en un chip de silicio aprendieran a jugar al videojuego «Doom», un avance que pone de manifiesto el potencial de los denominados «ordenadores biológicos».

El desarrollo fue realizado por expertos de Cortical Labs, quienes diseñaron una tecnología basada en el funcionamiento de las redes neuronales del cerebro. Cada uno de estos sistemas contiene aproximadamente 200.000 células cerebrales humanas vivas, cultivadas a partir de células madre obtenidas mediante donaciones de sangre.

Tras haber aprendido previamente a jugar «Pong», un videojuego de mecánica sencilla, las neuronas fueron sometidas a desafíos más complejos. Según Alon Loeffler, científico principal de aplicaciones de Cortical Labs, inicialmente las células mostraban un desempeño equivalente al de una persona sin experiencia en videojuegos. Con el tiempo, comenzaron a reaccionar de forma más precisa ante los estímulos del entorno digital.

Para el experimento, los investigadores transformaron los elementos del videojuego en patrones de señales eléctricas que las neuronas podían interpretar. Cuando aparecían enemigos en pantalla, determinados electrodos estimulaban las células del chip CL1, generando respuestas asociadas a acciones como desplazarse o disparar.

De acuerdo con la compañía, aunque la ejecución aún presenta limitaciones, los resultados demuestran que las neuronas pueden adaptarse a estímulos en tiempo real y desarrollar tareas de aprendizaje orientadas a objetivos. Los investigadores monitorean constantemente la actividad eléctrica de las células y ajustan las señales de entrada para influir en su comportamiento.

Los responsables del proyecto destacan que el chip CL1 tiene aplicaciones potenciales más allá de los videojuegos, incluyendo el desarrollo de fármacos y sistemas de aprendizaje automático. Brett Kagan, director científico y de operaciones de Cortical Labs, señaló que esta tecnología representa una forma de inteligencia que podría ofrecer capacidades complementarias a las de la inteligencia artificial tradicional.

Los investigadores también subrayan la eficiencia energética del cerebro humano, cuyo funcionamiento requiere alrededor de 20 vatios de potencia, una cifra que la computación basada en silicio y la inteligencia artificial aún no igualan. Sin embargo, reconocen que las células utilizadas tienen una vida útil aproximada de seis meses y todavía no generan resultados completamente consistentes y programables.

Analistas del sector consideran que uno de los principales aportes de esta tecnología podría ser la reducción del consumo energético frente a los chips convencionales. William Keating, director ejecutivo de la firma de investigación de semiconductores Ingenuity, afirmó que el proyecto representa un avance científico real en la búsqueda de sistemas informáticos más eficientes.

Principal

Lanzan en Nueva York aplicación sobre seguridad durante el Mundial

El público que asista a los partidos del Mundial de fútbol 2026 en el MetLife Stadium, en las afueras de Nueva York, o en las fanzones de esta región, podrá descargar una aplicación para recibir información sobre temas de seguridad en su idioma.

Disponible en Google Play y en la App Store de Apple, la aplicación «Public Safety by Everbridge» requiere una dirección de correo electrónico para registrarse.

La palabra clave «World Cup NJ» permite suscribirse a alertas específicas, enviadas directamente en el idioma del teléfono.

«Es la forma más rápida para nosotros de llegar a los aficionados, a los visitantes, tanto internacionales como nacionales», explica David Sierotowicz, encargado de coordinar las fuerzas de seguridad de Nueva Jersey, donde se encuentra el estadio, y de la vecina Nueva York.

Varias otras ciudades estadounidenses sede del Mundial, que se inician en dos semanas, el 11 de junio, también recurren a esta aplicación.

Con ocho partidos en el MetLife Stadium, incluida la final, el 19 de julio, y más de un millón de visitantes esperados, la región se enfrenta a un desafío «sin precedentes», reconoce el teniente coronel de la Policía Estatal de Nueva Jersey, David Sierotowicz.

Al evento futbolístico se suman las celebraciones por los 250 años de independencia de Estados Unidos el fin de semana del 4 de julio.

«No tenemos margen de error y no vamos a cometer errores», aseguró el jueves Sierotowicz durante una visita al centro de coordinación de las fuerzas de seguridad, situado en Nueva Jersey.

Entre las principales preocupaciones destacaron la gestión de las multitudes y de los desplazamientos —los organizadores dan prioridad al transporte público—, los ataques con drones y la trata de personas, objeto de una importante campaña de sensibilización.

«Ninguna amenaza creíble» pesa, en cambio, «al día de hoy», sobre la región y el Mundial por la guerra en Oriente Medio, según él.

El secretario de Seguridad Interior de Estados Unidos, Markwayne Mullin, ha indicado en redes sociales que la policía de inmigración (ICE) estará implicada en operaciones contra la falsificación o la trata de personas.

Pero Sierotowicz precisó que sus agentes no estarán «específicamente» en el MetLife Stadium.

En Nueva York, en particular, los agentes policiales locales (NYPD) estarán «muy presentes sobre el terreno», informó el coordinador del departamento de policía de la ciudad, Robert Gault.